Du rachat de Nginx

Rédigé par dada / 12 mars 2019 / 6 commentaires

C'est la grande nouvelle du moment : F5 Networks, société spécialisée dans l'équipement réseau, rachète Nginx. Cette annonce dégouline dans les réseaux sociaux et les premières craintes apparaissent.

Les protagonistes

F5 Networks m'était complètement inconnue. Jamais avant cette annonce je n'avais entendu parler de cette société. Pourtant, il semblerait qu'elle ait les moyens de poser presque un demi milliard d'euros pour acheter une entreprise concurrente. Concurrente ? Oui, puisqu'il semblerait que F5 ait pour spécialité les répartiteurs de charge, ce qu'est le boulot originel de Nginx.

Les précédents

Les débats démarrés dans Mastodon font remonter à la surface des souvenirs douloureux : lorsqu'une entreprise met la main sur un logiciel libre, les choses évoluent souvent de la même façon :

- OpenOffice, porté par Sun Microsystems, a été forké quelques de temps après le rachat de Sun par Oracle. Nous utilisons tous LibreOffice maintenant.

- ZFS, avec encore Sun et Oracle dans la partie, est devenu OpenZFS.

- MySQL, toujours avec les mêmes protagonistes, est maintenant complètement supplanté par MariaDB.

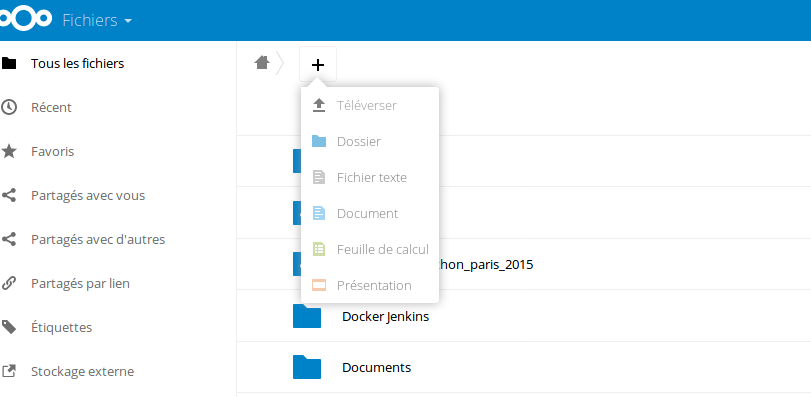

- OwnCloud est devenu Nextcloud quand l'entreprise derrière le projet s'est mise à mal gérer les contributions de sa communauté.

N'hésitez pas à aller voir la liste des forks connus. C'est impressionnant.

La licence

Nginx est sous licence BSD et F5 propose des services de répartiteur de charge (loadbal', en bon langage technique) : il n'est donc pas déconnant d'imaginer que F5 va vouloir mettre en avant ses propres solutions en y intégrant les atouts de Nginx. Tout ceci en n'étant pas le moins du monde obligé de redistribuer les améliorations qu'ils ne manqueront pas d'apporter à leur nouveau jouet hors de prix.

De fait, la licence BSD nous certifie que la dernière version de Nginx nous restera en l'état : accessible, modifiable, etc. C'est du libre (sans l'éthique). Cependant, rien n’oblige F5 à reverser les améliorations futures à la communauté. C'est la magie des licences maladroitement appelées Open Source face aux licences dites Libres.

La place de Nginx

Je me souviens avoir très (trop ?) souvent trollé Nginx quand il est arrivé dans le monde de l'hébergement. Je savais bien que c'était un excellent proxy mais je n'arrivais pas du tout à l'imaginer en tant que serveur web. J'étais clairement du côté d'Apache.

Avec le temps, les choses ont beaucoup évolué et je suis loin d'être le seul à avoir foutu du Nginx absolument partout, en loadbal, proxy et serveur. Mon infrastructure ne contient quasiment plus d'Apache. Là où il est encore présent est justifié par la flemme de le virer et de réécrire des configurations pour des gains en performance minimes.

Bref, Nginx est absolument partout, même si Apache revient dans la partie avec des performances de plus en plus proches, dans certains cas.

La suite ?

Comme dirait l'autre, bien malin est celui capable de faire des prévisions, surtout quand celles-ci concernent le futur. Pourtant, le monde libriste regorge d'exemples pouvant indiquer la direction possible que va prendre Nginx : le fork.

Tout dépendra de la réputation de F5 Networks, des choix qui vont être fait et de l'humeur des membres de la communauté Nginx. La suite de l'aventure va être passionnante à suivre et, là je peux le parier, la communauté s'en sortira par le haut, avec ou sans F5 Networks.